東京, 2024年5月9日 - (JCN Newswire) - 当社は、このほど、テキストや画像、数値などの複数の異なる形式のデータを、知識を抽象化して体系化するナレッジグラフとしてAIを用いて自動的に統合し学習することで、その大規模データから高精度に原因や内容を判定、推定する説明可能なAI技術を開発しました。本技術の有効性を確認するため、肺がんのタイプ分けや乳がん患者の生存期間予測など、医療分野の課題を含む複数のベンチマークで検証しました。その結果、例えば肺がんの主要な2つのタイプのタイプ分けを、病理画像情報にさかのぼってその要因を説明する形で高精度に判定支援できることを確認しました。

また絵画、線描画、イラスト、写真など、対象物の描かれ方が全く異なる画像の特徴量を抽出して学習し、高精度に判定する技術も開発しました。これらの技術を合わせることで、例えば病理画像などの十分な学習データを準備できない場合でも、ゲノム情報なども組み合わせて精度の高い判断を支援するAIを実現できることが期待されます。

今後、これらの開発したマルチモーダル技術(注1)を、医療分野だけではなく様々な領域で適用できる汎用的な技術として開発を進め、2024年度中に、当社が開発した様々な先端技術を試せる環境である「Fujitsu Research Portal(注2)」で公開する予定です。

背景

昨今、AIは急速に普及し様々な場面で活用されていますが、その多くはある特定のデータ形式や学習モデルに特化して使用されています。しかし、現実社会では一つの課題に対して複数の観点を同時に勘案して判断を行う場面が多くあります。例えば、医療分野では、検査数値情報のほか、画像情報やゲノム情報などの複数のデータを統合して分析することで、より高精度な判断を行うことができ、AIもこのような場面での活用が期待されていますが、複数の領域や分野、データ形式を統合して学習させることは困難とされてきました。

開発技術について

当社は、異なる分野や形式のデータを扱うマルチモーダル技術について研究開発を進めており、このたび、複数の異なるデータ形式や対象物の描かれ方が全く異なる画像データを統合して学習し、多様な観点から統合的に判断する以下2つのAI技術を開発しました。

1. 線描画や写真など、対象物の描かれ方が全く異なる画像データを統合して学習するAI技術

絵画、線描画、イラスト、写真など、対象物の描かれ方が異なる画像のデータを統合して学習させることで、例えば、写真のような新しい入力画像データに対して対象物に関する適切な判断ができる技術を開発しました。新しい実用場面では、十分な量の入力画像データを取得することが困難な状況が頻繁に発生しますが、本技術はこの課題の解決に寄与します。この手法では、対象物の描かれ方に特有の特徴量と、対象物の描かれ方に関わらない対象物共通の特徴量を併せて学習します。これにより、学習側データにおいて、絵、線描画、イラストなど対象物の描かれ方が様々であっても、知識を学習して対象物に関する適切な判断を行うことができるようになります。

本技術は、この研究分野で標準的に用いられ、美術や漫画、写真などの対象物の描かれ方が異なる複数種類の画像のデータセットを持つ3つのベンチマーク(PACS、 Office-Home、DomainNet)において対象物を判定したところ、従来技術と比較して2%前後の精度向上が認められました。この結果は著名な学会The International Conference on Learning Representations(ICLR)(注3)の大会ICLR 2024に採録され、当社は、2024年5月8日に本件の発表を行いました。

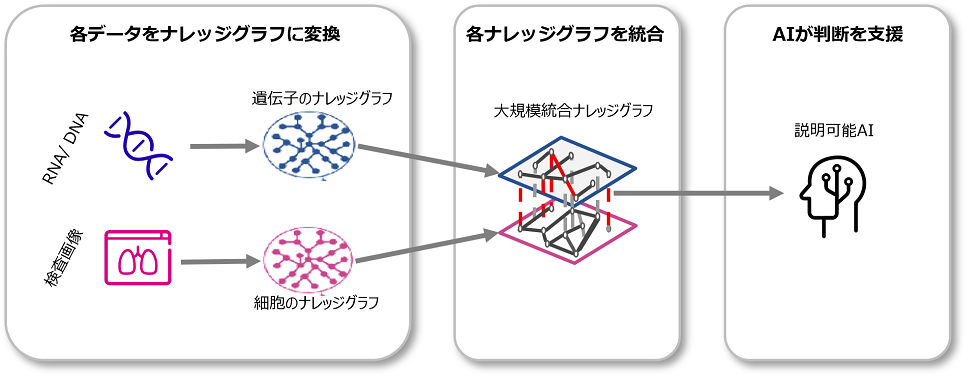

2. 異なる形式のデータを統合し、共通のナレッジグラフへ変換して学習する説明可能なAI技術

上記の技術を異なる画像データのみならず、テキストや画像などの異なるデータ形式に拡張し、各データを形式に依存しない共通的なナレッジグラフに変換した上で、それらをAIにより自動的に統合して大規模統合ナレッジグラフを作成し、それを用いて説明可能な形で判断を支援する技術を新たに開発しました。

本技術を以下の医療領域に適用したところ、従来技術を越える性能を達成することができました。この技術は今後、対象物の描かれ方が全く異なる画像データを統合して学習するAI技術と合わせて、十分な学習データを準備できない病理画像の判定においても、ゲノム情報まで組み合わせた判断支援を行えるようになることが期待されます。

1. 肺がんのタイプ分け

肺がんの治療では腺がん(注4)や扁平上皮癌(注5)などの肺がんのタイプごとに治療法が確立されつつあり、正しい治療にはタイプ分けを正確に行うことが重要です。これまで、医師が目視で複数の情報をそれぞれ確認し診察を行っていましたが、今回、本技術で肺がん患者の病理画像とゲノム情報(コピー数異常情報)を、AIを用いて自動的に統合し、がんのタイプの分けを行いました。その結果、世界で標準的にベンチマークに使われるThe Cancer Genome Atlas(TCGA)のデータを用いて評価したところ、肺がんのタイプ分けにおいて、従来87.1%が最高精度だったものを、本技術では92.1%という世界最高精度を達成しました。これらのタイプ分けの際には、病理画像データにさかのぼって判断の根拠を示すことが可能です。

2. 乳がん患者の生存予測の判定

患者が治療方法を選択する際に治療ごとの生存期間を正確に予測できると、適切な治療方法を選択できる可能性が高まります。今回、乳がん患者の画像データに加えてRNAデータ(注6)と診療データを、AIを用いて自動的に統合して判断することで、The Cancer Genome Atlas(TCGA)のベンチマークデータを用いて評価したところ、乳がん患者の生存期間予測タスクにおいて、従来最高精度が66.8%だったものを、本技術では71.8%を達成しました。これらの生存期間の予測を支援する際には、画像データの中からその根拠を示すことが可能です。

図1 異なる形式のデータを統合する共通的なグラフ形式へ変換

今後について

このたび開発した技術は、当社が開発した様々な先端技術を試せる環境である「Fujitsu Research Portal」で2024年度中に公開する予定です。

当社は、2023年に個別化医療の領域でスペインの研究機関であるBarcelona Supercomputing Center(注7)(Centro Nacional de Supercomputación、以下、バルセロナスーパーコンピューティングセンター)との共同研究を開始しています。今回のマルチモーダル技術を活用して開発したAI技術を、バルセロナスーパーコンピューティングセンターとの共同研究に活かし、さらなる精度向上およびグローバルでの認知獲得を目指して発展させていく予定です。

さらに当社は、本技術を医療分野だけでなく、データセンターの障害予測や詐欺検知など様々な領域で活用することを見据え技術を発展させていきます。

URL https://pr.fujitsu.com/jp/news/2024/05/9.html

Copyright 2024 JCN Newswire. All rights reserved. www.jcnnewswire.com